Levensechte plaatjes, maar nooit gebeurd: 'We moeten ons zeker zorgen maken'

De paus in een hippe winterjas, een hardhandige arrestatie van oud-president Donald Trump en foto's van achter de schermen bij de maanlanding: levensecht, maar toch nep. Afbeeldingen gemaakt door artificiële intelligentie (AI), kunstmatig dus, zijn steeds moeilijker van echt te onderscheiden. Een gevaarlijke ontwikkeling als het gaat om misinformatie, stelt hoogleraar media en digitale samenleving José van Dijck.

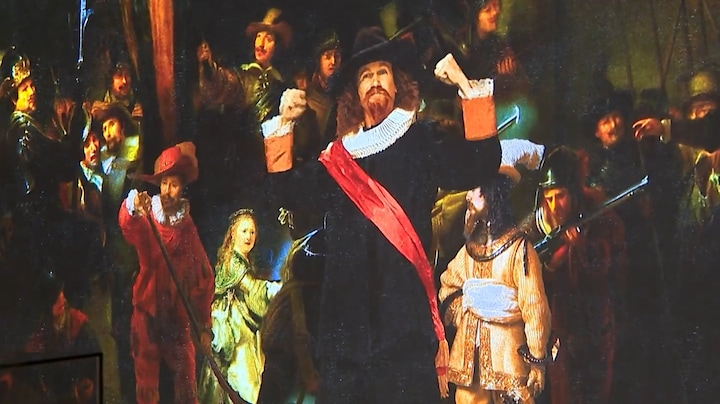

De nepbeelden zorgen voor verwarring op sociale media, vooral op Twitter. Zo worden afbeeldingen gedeeld van historische gebeurtenissen die nooit hebben plaatsgevonden, bijvoorbeeld 'de grote aardbeving van Oregon in 2001' en 'het in scène zetten van de maanlanding'. De vaak contextloze beelden worden vervolgens massaal gedeeld.

Je hebt niet alle cookies geaccepteerd. Om deze content te bekijken moet je deaanpassen.

Dat we continu scrollen op de kleine schermpjes van onze smartphones maakt het moeilijker om feit en fictie uit elkaar te houden, zegt hoogleraar Claes de Vreese van de Universiteit van Amsterdam. Hij is onder meer gespecialiseerd in artificiële intelligentie. Ook Remy Gieling, oprichter van AI.nl en expert op het gebied van AI, ziet dat mensen vatbaar zijn voor beelden die snel voorbijkomen. "Je kunt je niet bij elke foto gaan afvragen of het wel klopt."

Daarnaast ontbreekt vaak de context bij online gedeelde foto's. Volgens hoogleraar De Vreese wordt bij veel beelden slechts een brokje informatie gedeeld. Denk daarbij bijvoorbeeld aan foto's van de arrestatie van Trump, die nooit heeft plaatsgevonden. De AI-foto's van de arrestatie werden zonder context gedeeld, waardoor het voor veel mensen leek alsof het echt was gebeurd.

Sociale media proberen het gebrek aan context te bestrijden met factcheckers, maar daarmee 'bereik je maar een klein deel van de mensen die het oorspronkelijke beeld hebben gezien', zegt De Vreese.

Op Twitter hebben gebruikers de mogelijkheid extra informatie toe te voegen aan een tweet. Deze foto van de paus in pufferjas bijvoorbeeld, kreeg na publicatie extra context van andere gebruikers, waarin staat dat de foto door AI is gemaakt:

Je hebt niet alle cookies geaccepteerd. Om deze content te bekijken moet je deaanpassen.

Iedereen heeft toegang

Misinformatie en nepfoto's zijn van alle tijden, stelt José van Dijck, hoogleraar media en digitale samenleving bij Universiteit Utrecht. Maar waar je kortgeleden nog kennis van techniek en geschiedenis nodig had om nepbeelden te maken van historische gebeurtenissen, heeft iedereen tegenwoordig toegang tot AI.

Een zorgwekkende ontwikkeling, vindt Van Dijck. "Zeker op sociale media kun je nu met enorme snelheid beelden verspreiden die zijn gemanipuleerd, maar wel echt lijken."

AI-deskundige Remy Gieling plaatst daar een kanttekening bij: "Het genereren van hyperrealistische afbeeldingen is echt een vak. De tools zijn er wel, maar de juiste woorden vinden om tot het gewenste resultaat te komen is bijna een kunst." De drempel wordt volgens hem wel steeds lager. In deze video laat Gieling zien hoe je foto's met AI maakt.

Nu de ontwikkeling van AI-systemen razendsnel gaat, is het volgens Gieling steeds moeilijker te controleren of afbeeldingen wel echt zijn. Een getraind oog zou het volgens hem nog wel moeten kunnen zien.

Vuur met vuur bestrijden

Steeds meer organisaties houden zich bezig met het ontwikkelen van technologieën en algoritmes die AI-beelden kunnen herkennen. De algoritmes kunnen bijvoorbeeld aan de hand van pixels herkennen of een beeld door een computer is gemaakt. De crux is wel dat die algoritmes óók met AI worden gemaakt. "AI bestrijdt AI, dus je bestrijdt vuur met vuur", zegt Gieling.

Hoogleraar Van Dijck ziet watermerken als mogelijk hulpmiddel om nep van echt te onderscheiden. Elke foto, zowel echt als nep, zou dan een watermerk moeten bevatten. "Dan kun je altijd naar de bron gaan om te controleren of de foto echt is", legt Van Dijck uit.

Wetgeving

Hoewel AI veel mogelijkheden met zich meebrengt, zoals het 'boosten van de creativiteit van mensen' volgens Gieling, nemen de risico's van misinformatie steeds verder toe. Op Europees niveau wordt gekeken naar de wet- en regelgeving rondom AI: de AI-act.

Binnen die wet gelden drie risicocategorieën, namelijk onacceptabel risico, hoog risico en weinig risico. Als de wet wordt doorgevoerd, zouden AI-systemen met onacceptabel risico worden verboden en applicaties met hoog risico aan strenge voorwaarden moeten voldoen.

Daarbij wordt ook gekeken naar wie de verantwoordelijkheid voor misinformatie draagt, legt Van Dijck uit. Ligt de verantwoordelijkheid bijvoorbeeld bij de socialmediaplatformen die het verspreiden van nepinformatie mogelijk maken, of bij de consument? Er wordt nog aan de AI-act gewerkt.

Gezonde dosis achterdocht

Ook wetgeving heeft last van de snelle ontwikkeling van AI. Zo moest de AI-act al geüpdatet worden voor de wet überhaupt klaar was. "Wetgeving loopt per definitie achter op ontwikkelingen", zegt Van Dijck daarover.

Gieling raadt dan ook 'een gezonde dosis achterdocht' aan. Om jezelf tegen misinformatie te beschermen is het volgens hem verstandig om bij beelden op sociale media de vraag te stellen: is dit wel realistisch? De volgende keer dat de paus dan in een gekke outfit voorbijkomt op je tijdlijn, trap je er misschien minder snel in.