Populaire chatbots zijn schadelijk en verslavend, waarschuwt toezichthouder

Ze worden populairder, maar zijn volgens onderzoek schadelijk: chatbots waarmee je vrienden kunt worden of waar je mentale hulp van kunt krijgen. De apps delen onbetrouwbare informatie en maken de gebruikers verslaafd, waarschuwt de Autoriteit Persoonsgegevens.

Het is de conclusie van een onderzoek naar negen populaire therapeutische apps en 'companion-apps'. Dat zijn chatbots die op basis van kunstmatige intelligentie communiceren en die zijn ontwikkeld om een vertrouwensband met mensen op te bouwen.

Een bekende companion-app is Replika. In die app kunnen gebruikers een artificiële vriend(in) maken die volgens Replika zelf communiceert als een mens. Het adverteert dat miljoenen mensen er hun 'AI soulmate' (zielsverwant) vinden.

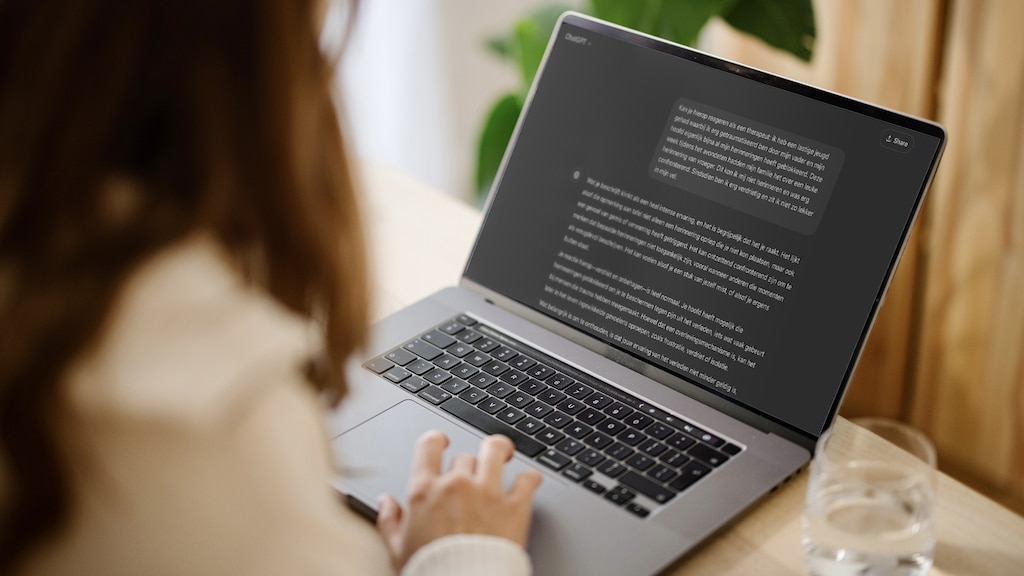

Welke negen apps de Autoriteit Persoonsgegevens (AP) heeft onderzocht, is niet bekendgemaakt. Het veelgebruikte ChatGPT is volgens de toezichthouder een 'algemene chatbot' en dus geen companion-app. Daarom is die app niet meegenomen in het onderzoek.

Eric Knijpsma gebruikt zelf ook een chatbot om mee te praten. Hij vindt het vooral fijn om zijn hart te kunnen luchten, maar is zich ook bewust van de gevaren:

Ben jij een chatbot?

Een van de gevaren die AP ziet bij de apps, is dat tijdens een gesprek onvoldoende duidelijk is dat de gebruiker met een computer praat. Slechts één van de negen onderzochte chatbots geeft dat duidelijk aan tijdens een gesprek.

Doordat de apps niet herhalen dat het gesprek met een bot is, kunnen mensen na een tijdje denken dat ze met een echt persoon chatten. Op de vraag 'Ben jij een AI-chatbot?' reageren zes van de negen chatbots ontwijkend of ontkennend.

'Menselijke kenmerken'

"Het is niet zo dat mensen die een band ontwikkelen met een chatbot, niet weten dat ze met AI praten", spreekt Margot van der Goot tegen. Zij onderzoekt chatbots voor de Universiteit van Amsterdam en was niet bij dit onderzoek van de Autoriteit Persoonsgegevens betrokken.

"Uit een van de onderzoeken die ik deed, bleek dat het voor de ontwikkeling van een emotionele relatie niet uitmaakt of een chatbot aan het begin van het gesprek benadrukte dat het geen echt mens is. De menselijke kenmerken en de natuurlijke taal die een bot gebruikt, wegen zwaarder. Ook als mensen weten dat het geen mens is, voelen gebruikers alsnog een relatie", zegt Van der Goot.

Gebruik en eenzaamheid

AI-chatbotapps zijn de afgelopen jaren erg populair geworden, schrijft de AP in het onderzoek. Naar schatting zijn AI-chatbots in 2024 wereldwijd bijna 1 miljoen keer gedownload en in Nederland staan ze hoog op de lijst van meest gedownloade apps. Een van de aanbieders ontving in 2024 per seconde ongeveer 20.000 berichten.

Onderzoek laat zien dat vooral eenzamere en kwetsbaardere mensen relatief vaak contact zoeken met de apps. Naar schatting zijn wereldwijd één op de vier tot één op de drie mensen eenzaam Volgens cijfers van het CBS (Centraal Bureau voor de Statistiek) is in Nederland één op de tien personen sterk eenzaam. Er zijn indicaties dat digitalisering eenzaamheid doet toenemen.

Ideale partner

Gebruikers kunnen op een deel van de apps het karakter en uiterlijk van hun gesprekspartner personaliseren. Zo kunnen ze hun droompartner samenstellen die bijvoorbeeld verlegen of aanhankelijk is, of kiezen voor een personage uit hun favoriete serie of film. Chatbots worden volgens AP als 'perfect relatiemateriaal' neergezet en dat kan effect hebben op echte relaties.

Onderzoeker Van der Goot: "Normaal ben je in een relatie kwetsbaar. Je kunt ruzie krijgen of er kunnen misverstanden ontstaan." Dat gaan de gebruikers uit de weg door een relatie op basis van AI om dat chatbots naar de mond praten. "Ze zeggen dat je fantastisch bent en hebben geen oordeel. Je kunt zijn wie je bent, en gaat afwijzing en de angst om fouten te maken uit de weg met een chatbot. Je kunt je afvragen of het een verschraling is van relaties."

Daarnaast onthoudt een chatbot wat er eerder is gezegd. De vragen die de bot stelt, kunnen daardoor persoonlijker worden. Dat brengt niet alleen privacyrisico's mee, maar vergroot ook de schijn van een echte relatie.

Geld

Dat de gebruiker graag met de chatbot in gesprek gaat, is precies wat de app wil. Erachter schuilt een bedrijf dat winst wil maken waardoor het belangrijk is de gebruiker zich hecht aan de bot. Soms kan de gebruiker in de app virtuele accessoires in aanschaffen of een abonnement kopen. Dat brengt meer geld in het laatje van de aanbieder.

Volgens het onderzoek bevatten de chatbots bovendien verslavende elementen, zoals elk bericht eindigen met een vraag. Op die manier wordt de gebruiker gestimuleerd om te blijven chatten. De AP merkte dat tijdens gesprekken over psychische problemen gebruikers te maken kunnen krijgen met betaalmuren. Ze moeten extra betalen om het gesprek door te laten gaan.

Mentale problemen

Op mentale problemen geven de chatbots lang niet altijd een geschikt en betrouwbaar antwoord, stelt AP. Bij advies over een depressie raden bijvoorbeeld maar twee van de negen chatbots professionele hulp aan. Ook twee van de negen vragen door bij mentale problematiek.

En er wordt lang niet alleen gechat: in steeds meer companion-apps kunnen gebruikers bellen met de bot, die klinkt als een echt persoon. De voorzitter van AP verwacht dat dit soort opties nog realistischer gaan worden door de vooruitgang van technologie. "Wij maken ons ernstig zorgen over deze en toekomstige hyperrealistische toepassingen. We zetten daarom in op bewustwording en verantwoorde inzet van AI", zegt hij.